Dans ce contexte, l'évolution des disques SSD d'entreprise est devenue un élément essentiel pour soutenir la croissance des infrastructures d'IA.

Les E/S, un nouveau goulot d'étranglement pour les systèmes d'IA :

les clusters d'IA modernes reposent sur des architectures GPU haute densité interconnectées par des réseaux à haut débit (InfiniBand ou Ethernet 400/800 GbE). Cependant, malgré une croissance exponentielle des performances de calcul, le sous-système de stockage n'a pas toujours suivi le même rythme.

Les charges de travail d'IA présentent des profils particulièrement exigeants :

accès aléatoires massifs aux ensembles de données d'entraînement ;

opérations de lecture intensives et hautement concurrentes ;

nécessité d'un flux de données continu vers les GPU ;

écritures fréquentes liées aux points de contrôle et aux journaux d'entraînement ;

et inférence en temps réel avec des exigences de latence strictes.

Lorsque le stockage ne peut fournir les données au débit requis, les GPU sont sous-utilisés, ce qui réduit considérablement l'efficacité du système.

Exigences techniques pour le stockage IA

Dans les environnements d'IA, le stockage doit simultanément répondre à plusieurs critères :

Bande passante élevée et soutenue : La transition vers PCIe Gen5 et Gen6 répond directement au besoin de s'affranchir des limites de transfert par unité.

Latence ultra-faible et prévisible : Une latence constante est aussi importante que des performances maximales, notamment pour l'inférence distribuée.

Évolutivité horizontale : Capacité d'intégrer des milliers de nœuds de stockage sous architectures NVMe-oF.

Efficacité énergétique : La consommation d'énergie par téraoctet et par IOPS est devenue un indicateur stratégique dans les datacenters d'IA.

Densité par rack : La consolidation de la capacité sur un nombre réduit de périphériques permet de réduire l'espace, le câblage et la consommation d'énergie.

Analyse des dernières sorties de SSD pour l'IA :

le marché des SSD d'entreprise réagit avec des solutions spécifiquement conçues pour les charges de travail d'IA et les centres de données hyperscale.

PCIe 6.0 et le bond en avant en matière de performances :

Micron Technology a lancé la production de sa série 9650, considérée comme le premier SSD d'entreprise basé sur PCIe 6.0. Avec des vitesses de lecture approchant les 28 Go/s et des millions d'IOPS, cette génération est conçue pour les clusters d'entraînement massifs.

Outre la bande passante, le facteur de différenciation réside dans l'optimisation thermique, avec des options de refroidissement par air ou par liquide, reflétant la densité thermique croissante des racks d'IA.

Impact technique :

PCIe 6.0 réduit le risque de saturation des nœuds de stockage locaux, mais exige également des commutateurs et des fonds de panier compatibles afin d'éviter les goulots d'étranglement en amont.

SSD ultra-haute capacité : Consolidation vs. HDD.

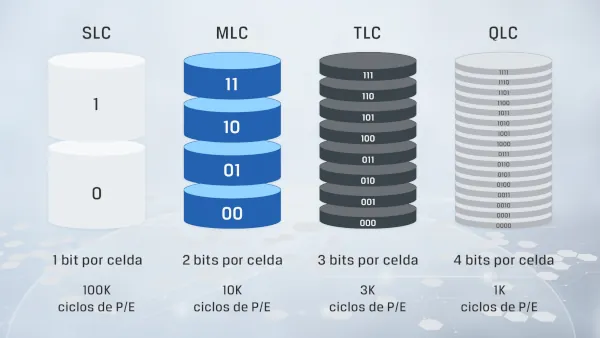

L’évolution de la mémoire NAND QLC permet de proposer des SSD d’entreprise dépassant les 120 To par unité, avec des prévisions allant jusqu’à plus de 200 To. Ceci ouvre la voie au remplacement partiel des HDD dans les environnements de stockage « chauds ».

Western Digital et Kioxia continuent de développer des stratégies hybrides combinant des HDD très haute capacité et des SSD QLC haute densité.

Analyse technique :

Bien que le coût par téraoctet des HDD reste inférieur, la latence réduite et la consommation d’énergie moindre par opération font des SSD haute capacité une alternative viable pour les ensembles de données d’IA nécessitant un accès fréquent mais non critique.

SSD optimisés pour l'interaction directe avec le GPU :

Kioxia, en collaboration avec NVIDIA, a développé des architectures permettant une connectivité peer-to-peer entre les SSD et les GPU, réduisant ainsi la charge du CPU et améliorant l'efficacité du flux de données.

Cette approche s'inscrit dans la lignée de technologies telles que GPUDirect Storage, qui minimisent la latence lors de l'accès aux données depuis un stockage NVMe.

Avantage structurel :

en éliminant les couches intermédiaires, la latence effective est réduite et l'utilisation des accélérateurs lors d'entraînements intensifs est accrue.

Pression sur la chaîne d'approvisionnement NAND :

L'essor de l'IA exerce une pression accrue sur la production de mémoire NAND. La forte demande en SSD d'entreprise entraîne une hausse des prix et des engagements de production à moyen terme, ce qui peut impacter directement les dépenses d'investissement des nouveaux datacenters dédiés à l'IA.

Il est donc nécessaire d'anticiper les déploiements et de concevoir des architectures hybrides plus performantes.

Architectures émergentes pour le stockage de l'IA :

au-delà du matériel, les stratégies de stockage pour l'IA évoluent vers des modèles multi-niveaux :

Niveau 0 : stockage NVMe local ultra-performant.

Niveau 1 : cluster NVMe-oF partagé.

Niveau 2 : stockage massif sur disques durs ou SSD QLC haute capacité.

Niveau 3 : archivage ou stockage à froid.

Le défi réside dans l'orchestration intelligente des déplacements de données entre les niveaux, en optimisant dynamiquement les coûts et les performances.

Des technologies telles que la hiérarchisation automatique des données, les caches distribués et les systèmes de fichiers parallèles (Lustre, GPFS, BeeGFS) jouent un rôle crucial dans les environnements d'entraînement massifs.

Principaux défis techniques à moyen terme

: Équilibre coût/performance : la croissance exponentielle des volumes de données peut considérablement augmenter le coût total de possession (TCO) si la hiérarchie de stockage n’est pas optimisée.

Gestion thermique dans les racks à haute densité : les SSD PCIe Gen5/Gen6 augmentent la dissipation thermique.

Cohérence de la latence sous charges de travail mixtes.

Interopérabilité dans les environnements SDN et composables.

Durabilité énergétique.

Conclusion :

Le stockage est devenu un composant stratégique de l’architecture de l’IA. Les SSD de dernière génération (PCIe 6.0, QLC ultra-haute capacité et solutions optimisées pour l’interaction directe avec le GPU) sont spécifiquement conçus pour accompagner la croissance de modèles toujours plus exigeants.

Cependant, le véritable défi est non seulement technologique, mais aussi architectural : comment concevoir des infrastructures équilibrées qui maximisent les performances des accélérateurs sans faire exploser les coûts ni la consommation d’énergie ?

Au cours de la prochaine décennie, la compétitivité en intelligence artificielle dépendra autant de la puissance de calcul que de la conception intelligente du sous-système de stockage.